Bosch mobility experience 2017 report @Boxberg vol.4

【ボッシュ・モビリティエクスペリエンス2017レポート】

・vol.1 EV化、自動運転、常時接続は避けては通れないクルマの未来

・vol.2 ストレス・ゼロのアーバンモビリティとは何か?交通インフラの再整備

・vol.3 自動運転にAI人工知能は何故必要なのか?

・vol.4 自動運転のためのソリューションレポート ドライビングアシスタンス篇

・vol.5 自動運転のためのレーダーロードシグネチャー&ハッキング篇

・vol.6 NOxとCNGで空気の質を改善

2017年夏に開催したボッシュのモビリティ エクスペリエンスだが、これまで当サイトの「雑誌に載らない話」で、そして、Automobile studyのコーナーで、未来の都市交通のあり方から捉え、自動運転にはなぜAIが必要になるのか?といことを前回までにお伝えしてきた。今回は、これまでの自動運転技術のソリューションをまとめ、これからの展開についてのワークショップをレポートしよう。<レポート:高橋 明/Akira Takahashi>

■これまでのドライビングアシスタンス運転支援技術

ここまでのレポートを読んで頂ければ、自動運転は乗り心地の良さと安全性のヒーローとなりうることがお分かりになるだろう。例えば駐車のサポートは有人、無人でのアシスタンス技術や、歩行者の認識補助などで事故を防ぐことができるところまで現在はたどり着いたと言っていい。さらにドライバーの監視により眠気やわき見などを理解するソリューションもある。暗くなった時に自動でヘッドライトのロー/ハイを切り替えるなども徐々に普及が始まっている。

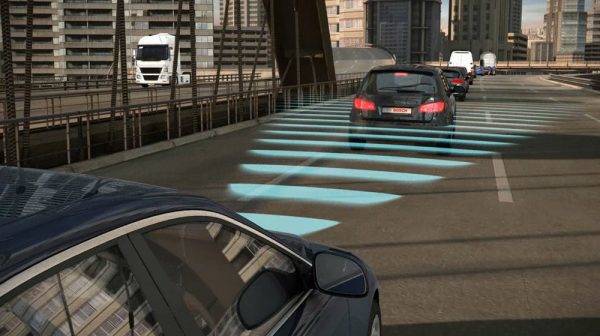

こうしたこれまでの技術を簡単に紐解くと、自動緊急ブレーキは何をしているかと言えば、周囲を認識していることになる。歩行者を認識し、ぶつかると判断すれば自動ブレーキが稼働する。が、あくまでも人間の判断のアシストではある。そして、歩行者を認識して自動で停止するまでの時間は1/100秒の速度で反応でき、当然、人よりも速く反応できるから、便利で安全と認識は変化してくわけだ。

また、左折(日本では右折)アシストはレーダーベースシステムが対向車を正確に認識し、どれくらいの距離でどれくらいの速度で近づいてくるのか判断する。自車は発進できないようにブレーキをかけつつ、通過を待つ。これは昼夜、天候を問わず使えるレーダーシステムによって実現している。(国内に実装車はまだない)

駐車アシストでは360度のサラウンドで検知するが、4つのカメラを搭載し、前方後方、左右のミラーの位置に搭載して周囲を監視する。これにはパワフルなCPUが搭載され、ピープルビューという監視を行ない、狭い空間でも正確に駐車できる能力がある。

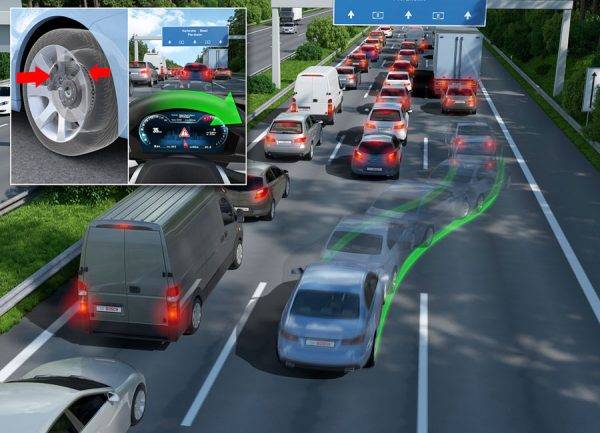

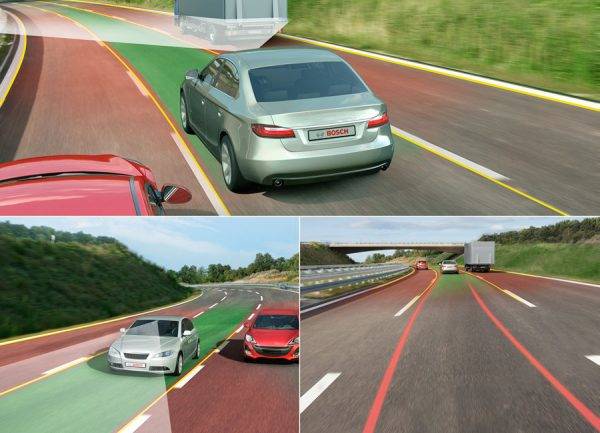

ハイウェイオートメテッドドライブにはACC(アダプティブクルーズコントロール)があり、次のステップはレーンキープと組み合わせることだ。前後、左右の幅を合わせることや、渋滞間における運転アシスト、レーンがない場合など、カメラシステムでできるように対応している。これはカメラベースのシステムもあり、学習させて、相応車線がなくても走行できるようにしている。というのがこれまでボッシュが提供している運転支援技術になる。

■技術の進化により

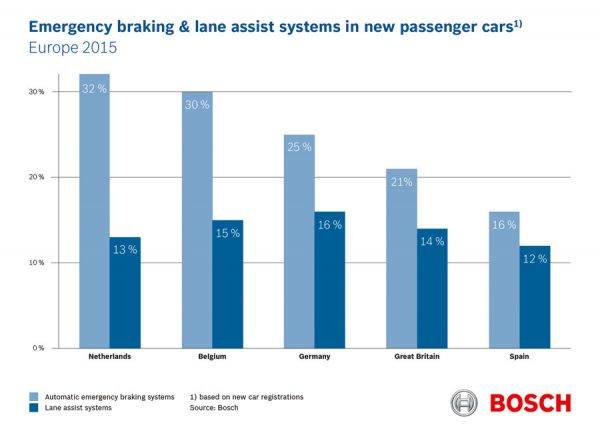

さて、これらの運転支援技術をさらに進化させていければ、安全性のさらなる向上につながり、現在の事故の9割がドライバーのミスによる事故という調査結果があり、年間120万人が事故で死んでいる。それが、これらの技術によって、その9割助けられたらすごいことだと思う。

さらに、こうした高度な運転支援技術の進化は、モビリティの民主化という性格を持つことにもなり、運転ができなくなった高齢者でも自由に移動できるようになる。また燃費の良さという側面では、勾配のベストなルートが選択されるようになる。これらのアシスタンス技術は、渋滞を減らすことができるし、さらにその先の自動走行ができれば、時間を有効に使えるということにもなる。そして、こうしたことは市場に変化をもたらすことは間違いない。

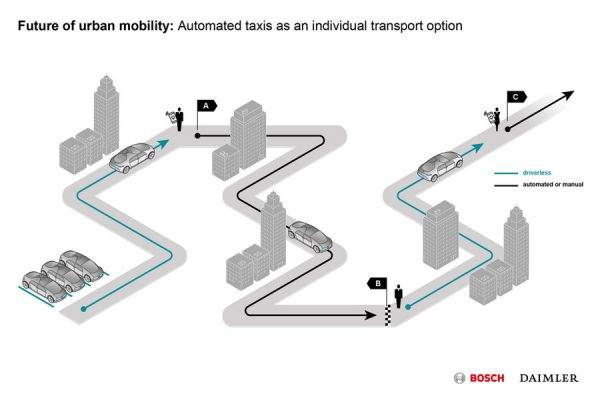

メルセデス・ベンツとボッシュで提案した「F15」というコンセプトモデルでデモンストレーションしているものは、都市部で移動している人やアーバンタクシーという利用方法では、ドアtoドアでの移動が自動運転になるというものだ。

レベル分けに目を向けてみると、レベルゼロはマニュアルドライブで現在のクルマがこれに相当する。レベル1、2はアシスタンスシステムがあり、普及が始まったところだ。レベル3から4、5へと進むにはドライバーの監視義務のある領域を徐々に減らしていくということであり、いわゆる自動運転に近づいていくわけだ。

例えばレベル3ではもし何かあるようであれば、ドライバーがすぐに運転に戻れるもので、安全性を確保するには、ドライバーがまだ必要とされるものだ。そのドライバーへの期待がレベル4になるとなくなるわけだ。ただし、高速道や一部の都市部など、限定的なエリアでの自動運転ということになる。そしてレベル5は、まだまだ遠い先のこととだが、いつでもどこでも自動で運転されるというものだ、ということになる。

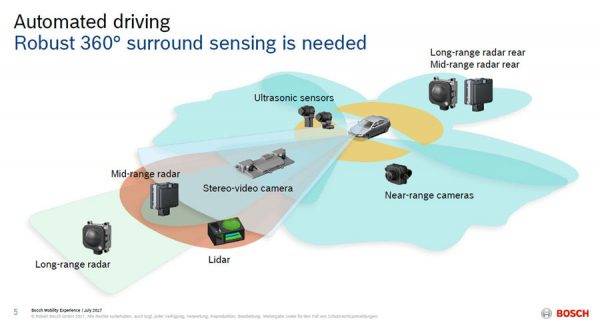

さて、こうした自動運転の進化を支えるセンサー技術に目を向けてみると、センサーは情報を得て、判断して、動かすということが必要であり、そのためには360度の範囲でセンサーが必要となる。ミリ波レーダーで言えば長距離250mくらいのレーダー、中距離80mがあり、ライダー(レーザースキナー)という技術も入ってきた。これはレーザーレーダーベースの技術で200mから250m先のデータが取得できる。そしてステレオカメラにより、近いところの画像が取れ、およそ70mから80mまでの情報がとれる。車両後方は中・長距離レーダーが必要だ。

一方、ソナーなど超音波センサーは6m程度のセンシングが可能なのだが、高速では役に立たない。それは、ドイツでの一般的な車速の130km/hだと、1秒で36m進むので役に立たないということだ。反面、レーダーは熟成した技術ではあるが、柔らかいものの認識が苦手で、木材などが苦手だ。また、人間は水分を含んでおり、レーダーが反射するので問題ない。

このように、レーダーは通常であればほとんどの物体を認識し、見つけることができるが、認識できなかった時に、そこがフリースペースだと認識してしまうことがある。それがレーダーの弱点になる。超音波ソナーは、じつはそこが正確に認識できるという特徴があるのだ。また、カメラは、人間の目で見えないものはカメラでも見えないという画像認識技術だ。つまり、コントラストがないと見えないので、霧や雪などホワイトアウトした状態では認識ができなくなってしまう。

というように、それぞれの得意とするものと苦手なものがあるが、レーダーとライダーは一緒に組み合わせて使う必要がある。ライダーは、印象派の絵画のような認識をしていき、正確に認識する。どういうことかと言うと、空間と時間による光の質の変化を正確に捉え、動くものなどをある範囲内認識する動きの包摂などを得意とするわけだ。

だが、キーポイントは光で、光が反射したりしなかったりすると問題となる。例えば、雨、積雪が多いとライダーでは100%の精度の補償ができず、レーダーとライダーの両方が情報を得て、どっちを優先するのかという判断をしていく必要があるわけだ。

さて、次回はこうしたレーダー技術をさらに進化させた、レーダーロードシグネチャーや高精度な3Dマップとの連携による、正確な自車位置検索=ローカリゼーションの実現、そして通信に対するハッキング対策、未来の自動運転に必要なHMI(ヒューマンマシン・インターフェイス)のワークショップをレポートする。

【ボッシュ・モビリティエクスペリエンス2017レポート】

・vol.1 EV化、自動運転、常時接続は避けては通れないクルマの未来

・vol.2 ストレス・ゼロのアーバンモビリティとは何か?交通インフラの再整備

・vol.3 自動運転にAI人工知能は何故必要なのか?

・vol.4 自動運転のためのソリューションレポート ドライビングアシスタンス篇

・vol.5 自動運転のためのレーダーロードシグネチャー&ハッキング篇

・vol.6 NOxとCNGで空気の質を改善